Nvidia a mis en ligne Lyra 2.0. C’est une nouvelle version de son outil de création d’environnements virtuels. Elle transforme une simple image fixe en un espace tridimensionnel complet et cohérent. L’innovation majeure ? La capacité du système à mémoriser les lieux pour éviter les erreurs visuelles lors de l’exploration.

Imaginez que vous visitez un appartement créé par une intelligence artificielle classique. En tournant la tête, vous remarquez que la porte d’entrée a changé de place ou que la fenêtre a disparu. Ce problème survient car l’ordinateur ne comprend pas vraiment la structure de l’espace qu’il dessine. Il se contente d’inventer chaque image sans se soucier de la précédente. La sortie de Nvidia Lyra 2.0 apporte une solution concrète à ce manque de stabilité géographique.

Nvidia Lyra 2.0 met fin à l’instabilité des décors dans les mondes virtuels

La première version de cet outil, lancée fin 2025, savait déjà créer des vidéos réalistes à partir de photos. Elle pouvait simuler un mouvement de caméra pour donner l’impression de se déplacer dans une image. Cependant, elle souffrait d’un défaut majeur appelé l’instabilité chronique. Dès que le chemin devenait trop long, le décor commençait à se déformer de manière imprévisible. Les objets perdaient leur forme et les perspectives devenaient fausses.

Avec l’arrivée de Nvidia Lyra 2.0, ces défauts sont en grande partie corrigés. Les chercheurs ont ajouté une forme de mémoire à long terme au logiciel. Désormais, le programme ne se contente plus de générer des pixels. Il construit une structure mathématique solide qui représente le volume de la scène. Cela signifie que si vous quittez une pièce pour y revenir plus tard, elle sera exactement dans le même état. Cette persistance est un changement fondamental dans le domaine de l’intelligence artificielle générative.

Le système utilise une architecture moderne basée sur les transformateurs de diffusion. C’est le même type de technologie qui permet de créer des textes ou des images de haute qualité. Ici, elle est optimisée pour la vidéo et la profondeur. Le modèle analyse les volumes et les textures pour s’assurer que tout reste à sa place. Cette base technique permet de produire des séquences fluides à une résolution de 832 par 480 pixels.

L’astuce technique pour éviter l’oubli et les déformations

Dans le monde de l’informatique, deux problèmes empêchaient jusqu’ici de créer de grands mondes virtuels. Le premier est l’oubli spatial. C’est un peu comme un humain qui oublierait la disposition de son propre salon dès qu’il ferme les yeux. Le modèle génère alors de nouveaux détails qui ne correspondent plus à l’original. Le second problème est la dérive temporelle. Ce sont des petites erreurs qui s’ajoutent les unes aux autres. À la fin d’une vidéo, la scène peut ne plus ressembler du tout à la photo de départ.

Pour contrer l’oubli, Nvidia Lyra 2.0 enregistre la position de chaque point dans l’espace. Il utilise une technique de récupération d’images basée sur la géométrie. Quand la caméra virtuelle revient vers un endroit déjà vu, le logiciel va chercher dans sa base de données la structure exacte qu’il avait créée. Il ne réinvente rien, il retrouve simplement l’information. C’est ce qui garantit que les murs ne bougent pas et que les meubles restent fixes.

Concernant la dérive temporelle, les ingénieurs ont utilisé une méthode d’entraînement originale. Ils ont appris au modèle à reconnaître ses propres erreurs. En lui montrant des images légèrement déformées, le logiciel a appris à se corriger de lui-même pendant la création du monde 3D. Cette capacité d’autocorrection est essentielle pour maintenir la qualité visuelle sur de longues distances. Sans cela, le monde virtuel finirait par devenir flou ou incohérent après seulement quelques mètres de marche virtuelle.

Guidez l’IA à la souris pour visiter les recoins cachés de vos images

Le processus de création commence toujours par un fichier image classique, comme un format JPEG ou PNG. Une fois que l’utilisateur soumet sa photo, l’algorithme commence par estimer la profondeur de chaque élément. Il crée ce qu’on appelle un nuage de points. Ce nuage est une collection de milliers de coordonnées qui forment le squelette de la scène. C’est à partir de cette base que le reste de l’environnement va être « tissé ».

L’utilisateur dispose ensuite d’une interface graphique très simple. Il peut dessiner un trajet avec sa souris comme s’il guidait un personnage dans un jeu vidéo. Nvidia Lyra 2.0 va alors générer les images manquantes pour remplir les zones que la photo initiale ne montrait pas. Par exemple, si vous prenez une photo de votre cuisine, vous pouvez demander à l’IA de voir ce qui se trouve derrière le bar ou dans le couloir adjacent. Le modèle imagine le reste tout en restant fidèle au style de la première image.

Une fois l’exploration terminée, le résultat peut être exporté sous plusieurs formats. Le plus innovant est le « Gaussian Splatting ». Cette technique remplace les traditionnels triangles des graphismes 3D par des sortes de taches colorées très précises. Cela permet d’obtenir un rendu beaucoup plus réaliste des reflets, de la lumière et des textures complexes comme les feuilles des arbres ou les tissus. On peut aussi obtenir des maillages classiques pour les logiciels de création standard.

Un entraînement intensif pour les robots de demain

L’une des applications les plus sérieuses de la technologie Nvidia Lyra 2.0 concerne la robotique. Apprendre à un robot à se déplacer dans un entrepôt ou une maison est complexe et coûteux. Il faut souvent construire des décors réels ou passer des centaines d’heures à modéliser des environnements à la main. Grâce à Nvidia Lyra 2.0, on peut désormais créer des milliers de simulations différentes à partir de quelques photographies de lieux réels.

Ces mondes virtuels sont ensuite injectés dans des plateformes comme Isaac Sim. C’est un simulateur où les robots virtuels apprennent à éviter des obstacles ou à saisir des objets. Comme l’environnement est persistant, le robot peut s’entraîner à mémoriser son chemin. S’il fait demi-tour, il retrouvera les mêmes obstacles au même endroit. C’est crucial pour que l’apprentissage soit efficace et que le robot puisse ensuite fonctionner dans le monde physique sans accident.

Cette méthode permet de tester des situations dangereuses sans aucun risque matériel. On peut simuler des chutes, des collisions ou des pannes dans un univers numérique parfaitement contrôlé. Le réalisme visuel aide aussi les capteurs des robots, comme les caméras de profondeur, à s’habituer aux conditions de lumière réelles. Le passage de la simulation à la réalité devient alors beaucoup plus simple et rapide pour les entreprises du secteur.

De nouvelles perspectives pour le cinéma et le jeu vidéo

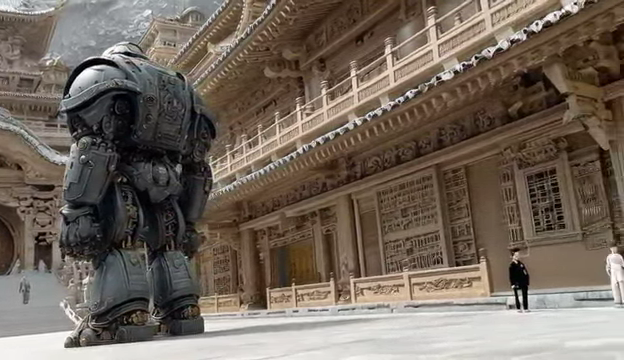

Le secteur du divertissement regarde aussi cette nouveauté avec beaucoup d’intérêt. Pour un réalisateur de films, préparer une scène demande normalement beaucoup de travail de repérage et de dessin. Avec Nvidia Lyra 2.0, il suffit de prendre une photo d’un lieu pour pouvoir ensuite le visiter virtuellement sous tous les angles. On peut prévoir les mouvements de caméra et tester des cadrages avant même que l’équipe de tournage n’arrive sur place.

Les développeurs de jeux vidéo indépendants y voient aussi un gain de temps énorme. Créer des décors réalistes demande souvent des mois de travail à des équipes entières. Ici, la génération automatique permet de produire des bases de niveaux très rapidement. Un artiste peut ensuite reprendre le résultat pour y ajouter sa touche personnelle. Cela n’élimine pas le travail humain, mais cela supprime les tâches les plus répétitives et les plus longues de la modélisation initiale.

La fluidité de l’outil permet même d’envisager des expériences en réalité virtuelle. On pourrait imaginer visiter des lieux historiques ou des destinations de voyage à partir d’une simple archive photographique. Le sentiment de présence est renforcé par le fait que l’espace ne change pas brusquement. La stabilité visuelle est l’élément qui permet au cerveau d’accepter l’illusion d’un monde réel. Sans cette cohérence, l’utilisateur pourrait ressentir une forme de malaise ou de nausée virtuelle.

Une technologie accessible et ouverte à tous

Nvidia a fait le choix de la transparence pour ce projet. Le code source et les modèles mathématiques sont disponibles en « open source » sous licence Apache 2.0. Cela signifie que n’importe quel chercheur ou entreprise peut télécharger l’outil pour l’étudier ou l’intégrer dans ses propres logiciels. Cette décision favorise une progression rapide de la technologie grâce aux retours de la communauté mondiale.

Pour utiliser Nvidia Lyra 2.0, il faut néanmoins posséder un ordinateur puissant. Le traitement de 14 milliards de paramètres demande une carte graphique avec beaucoup de mémoire vidéo. Ce n’est pas encore un outil que l’on peut faire tourner sur un simple smartphone, mais la puissance des ordinateurs domestiques augmente chaque année. Des versions plus légères pourraient voir le jour à l’avenir pour rendre la création de mondes 3D encore plus populaire.

En attendant, les plateformes comme Hugging Face permettent déjà de tester les capacités du modèle. D’autres entreprises comme Google proposent des systèmes similaires, mais le framework de Nvidia se distingue par ses outils d’exportation vers le monde de l’industrie. Le fait que l’on puisse transformer une vidéo en un objet 3D solide et réutilisable change la donne. On ne se contente plus de regarder une image, on commence à construire des réalités numériques de manière automatisée. Nvidia Lyra 2.0 marque ainsi une étape importante dans la fusion entre la photographie et l’espace virtuel.

- Partager l'article :