La robotique moderne entre dans une ère nouvelle. L’IA embarquée devient aussi cruciale que la mécanique. Ainsi, la plateforme Jetson Thor s’inscrit dans cette évolution. Elle propose une architecture pensée pour les robots autonomes. Ce système centralisé vise à répondre aux exigences les plus exigeantes de la robotique moderne.

Désormais, les machines doivent comprendre des instructions verbales. Elles détectent aussi les objets avec une latence de l’ordre de quelques dizaines de millisecondes. Par conséquent, elles traitent la perception et le contrôle simultanément. De plus, les processeurs évitent les obstacles de manière fluide. Cette puissance rend possible une prise de décision à très faible latence, au cœur de l’autonomie des robots.

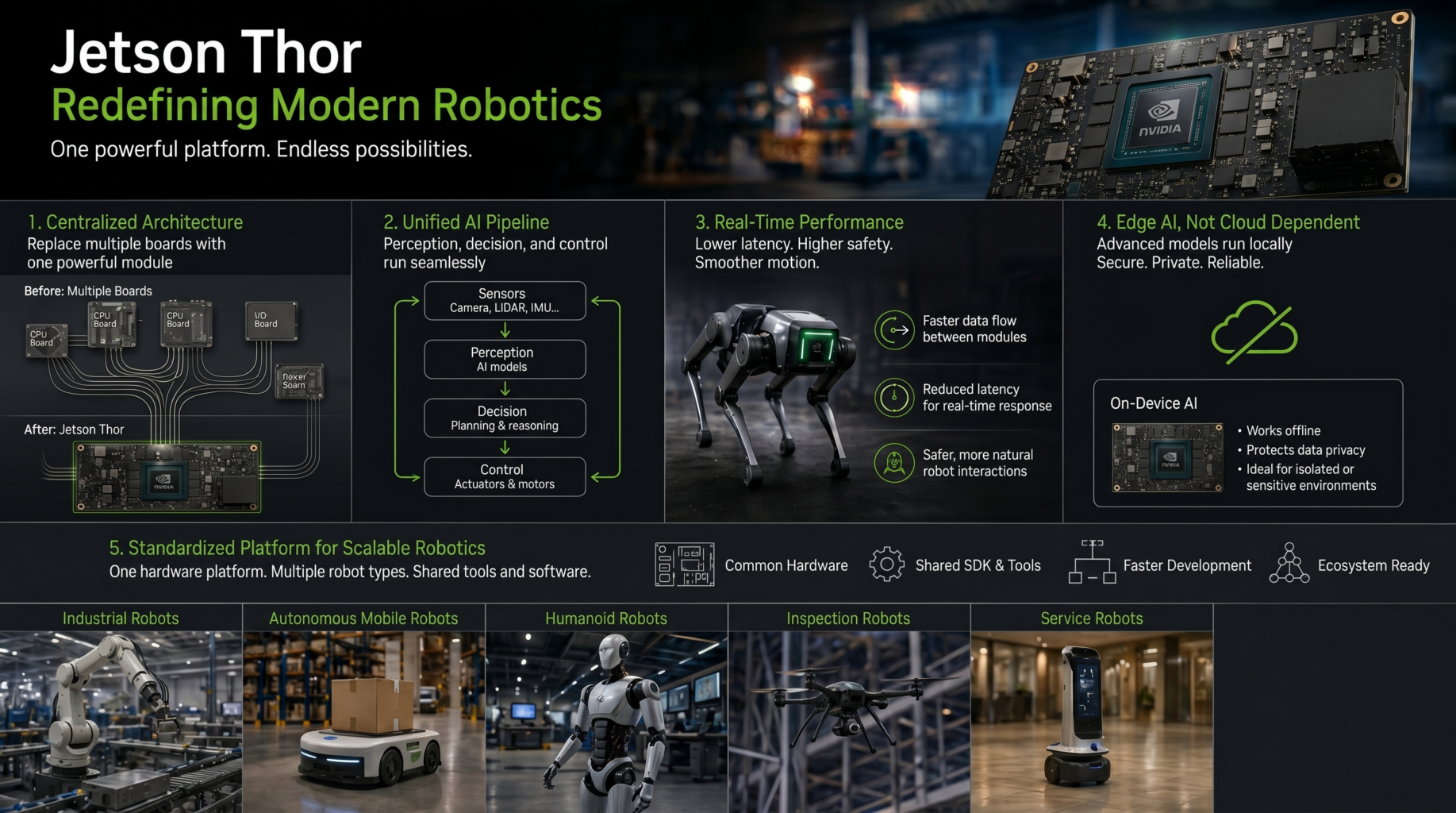

Qu’est‑ce que le Jetson Thor ?

Le Jetson Thor est une nouvelle génération de plateforme IA embarquée conçue par NVIDIA. Il prolonge la gamme Jetson en remplaçant ou en complétant les solutions Orin et Xavier. On le présente comme un cerveau d’IA pour la robotique physique et les systèmes autonomes. Il s’adresse aux robots, aux véhicules autonomes et aux drones qui nécessitent une puissance de calcul concentrée.

Techniquement, le Jetson Thor existe sous forme de module SoM (System on Module). Ce module est intégré dans une carte porteuse pour former un système complet. Il combine un GPU de nouvelle génération, un CPU Arm et de la mémoire haute vitesse. NVIDIA annonce une architecture Blackwell dédiée à l’inférence IA embarquée, avec une forte puissance de calcul.

En termes de performance, NVIDIA indique jusqu’à environ 2070 TFLOPS FP4, obtenus grâce au GPU Tensor Core en mode IA, dans certains scénarios. Ce chiffre est atteint en optimisant l’architecture et l’efficacité énergétique. Thor peut ainsi faire tourner des modèles LLM, VLM et des réseaux de vision avancés localement. La puissance est dimensionnée pour des applications robotiques vraiment exigeantes.

Concrètement, le Jetson Thor devient le cerveau central d’un robot autonome. Il gère la perception visuelle, la compréhension du langage, la logique de décision et la synchronisation des actionneurs. Il remplace plusieurs contrôleurs séparés par un seul module intègre et puissant. Cette centralisation simplifie la conception, la maintenance et la validation des systèmes robotiques.

Les origines du Jetson Thor dans l’écosystème NVIDIA

Le Jetson Thor ne surgit pas de nulle part, il s’inscrit dans une lignée de plateformes embarquées. Les premiers Jetson Nano et Xavier ont popularisé l’IA embarquée grand public. Orin a ensuite consolidé la position de NVIDIA dans la robotique industrielle. Thor s’impose comme la version suivante de cette évolution technique.

NVIDIA a annoncé le Jetson Thor lors de conférences dédiées comme le GTC. La firme le présente comme une étape clé pour la robotique physique et l’ IA incarnée. Il s’agit d’IA qui agit dans le monde réel, par exemple via des robots ou des véhicules. Cette vision structure la stratégie matérielle et logicielle de NVIDIA.

Les documents officiels montrent que Thor sert de base pour la robotique humanoïde. Les fabricants de robots humanoïdes s’appuient sur ce type de module pour des démonstrateurs. Les performances sont pensées pour la multi-caméra, la reconnaissance d’objets et le contrôle de mouvement. NVIDIA positionne Thor comme un socle commun pour plusieurs secteurs.

Enfin, Thor s’intègre dans un écosystème élargi : Isaac,Drive,Omniverse etJetPack. Ces outils permettent de développer, tester et déployer des applications robotiques. Le module profite directement de cette richesse logicielle. Il hérite donc d’années de travail sur la robotique et l’IA embarquée.

Architecture matérielle : le cœur du cerveau IA de la robotique moderne

Le Jetson Thor repose sur une architecture GPU Blackwell spécifique. Cette génération vise un meilleur rapport performance/consommation pour l’inférence IA. NVIDIA annonce une forte puissance en calculs entiers et en opérations de type Tensor. Cela répond aux besoins des modèles de vision et de langage.

Sur le CPU, Thor utilise une architecture Arm Neoverse‑V3AE à 14 cœurs. Cette solution est adaptée aux tâches de contrôle et de gestion système. Elle gère les communications, les entrées‑sorties et les tâches de fond. Le couplage avec le GPU permet une répartition efficace des charges.

En termes de spécifications, le module dispose d’un grand nombre de cœurs CUDA et Tensor. Certains documents indiquent environ 2560 cœurs CUDA et 96 cœurs Tensor. La puissance brute atteint 7,8 TFLOPS en précision simple. Ces chiffres sont publiés par NVIDIA et repris par des analyses techniques.

La consommation électrique est comprise entre 40 W et 130 W selon la configuration. Le format du module SoM est d’environ 243 x 112 x 56 mm, ce qui reste compact. Thor est conçu pour être intégré dans des robots sans occuper trop d’espace. Cette taille permet une intégration dans des châssis variés.

Performance et benchmarks vérifiables pour la robotique moderne

Les performances annoncées donnent une première idée de ce que le Jetson Thor peut faire. NVIDIA cite jusqu’à 2070 TFLOPS FP4, obtenus grâce au GPU Tensor Core en mode IA, avec une efficacité énergétique nettement supérieure à Orin AGX. Ces gains concernent surtout l’inférence temps réel et la gestion de flux vidéo. La latence est réduite, ce qui est crucial pour la robotique.

Des analyses techniques indépendantes confirment en partie ces chiffres. Les tests portent sur la bande passante mémoire, la fréquence de traitement et la charge CPU/GPU. Les résultats montrent que Thor peut traiter plusieurs flux de caméras haute résolution en simultané. Ceci est essentiel pour les robots qui doivent voir leur environnement à 360 degrés.

En pratique, ces performances permettent de déployer des modèles plus complexes directement sur le robot. Des réseaux de détection d’objets, de segmentation ou de suivi de personnes y tournent en temps réel. Les réactions du robot deviennent plus rapides et plus précises. La marge de sécurité s’améliore dans les environnements dynamiques.

Enfin, les benchmarks montrent que Thor peut gérer des modèles LLM et VLM embarqués. Il traite des requêtes textuelles pendant que le robot perçoit son environnement. Cela permet de combiner compréhension du langage et action physique. La robotique moderne gagne ainsi en souplesse d’interaction.

Adoption par l’industrie : qui utilise le Jetson Thor aujourd’hui ?

Plusieurs entreprises de robotique ont intégré le Jetson Thor dans leurs plateformes. Elles l’utilisent pour développer des prototypes de robots humanoïdes complexes. Les performances permettent de combiner plusieurs fonctions IA dans un seul module. Cela réduit le nombre de cartes et la complexité électrique.

Des projets de logistique automatisée s’appuient aussi sur Thor pour des robots de convoyage. Ces systèmes doivent traiter des données de caméras, de LiDAR et de capteurs de proximité. La latence doit être extrêmement faible pour éviter les collisions. Thor permet de centraliser ces traitements dans un environnement unique.

Dans le domaine des véhicules autonomes, certains concepteurs utilisent Thor comme cerveau de calcul. Il gère la perception, la fusion de capteurs et les décisions de trajectoire. Les diagrammes publiés montrent un flux de données passant de capteurs à Thor, puis aux actionneurs. Cette architecture est clairement documentée et reproductible.

Enfin, des laboratoires de recherche et des universités s’équipent en kits de développement Thor. Ils les utilisent pour tester de nouveaux algorithmes de contrôle et de planification. Ces retours alimentent des publications et des benchmarks ouverts. Thor profite ainsi d’une communauté technique active et vérifiable.

Comment le Jetson Thor redéfinit‑t‑il concrètement la robotique moderne ?

Le Jetson Thor change la manière de concevoir un robot moderne. Plutôt que d’empiler plusieurs cartes dédiées, on centralise autour d’un seul module puissant. Ce choix simplifie le câblage, la gestion thermique et la maintenance. Il réduit aussi les points de défaillance potentiels.

La consolidation de la perception, de la décision et du contrôle améliore la cohérence du système. Les données circulent plus vite entre les composants logiciels. Les délais de réaction sont réduits, ce qui augmente la sécurité et la fluidité des mouvements. Les robots peuvent évoluer plus naturellement dans des lieux humains.

Thor permet aussi de déployer des modèles plus avancés directement sur le robot. Au lieu de tout envoyer dans le cloud, une partie du traitement se fait en local. Cela réduit la dépendance à la connectivité et améliore la confidentialité des données. Les robots peuvent fonctionner dans des environnements isolés ou sensibles.

Enfin, cette architecture favorise une standardisation de la robotique moderne. Les fabricants peuvent bâtir plusieurs robots sur une même base matérielle. Les logiciels et outils restent compatibles entre projets. Thor devient un socle commun pour une nouvelle génération de machines autonomes.

Limites techniques et contraintes actuelles du Jetson Thor

Malgré ses performances, le Jetson Thor présente des limites techniques réelles. Sa consommation électrique peut atteindre 130 W sous forte charge. Cela impose des systèmes de refroidissement adaptés et une gestion de l’autonomie. Les robots embarqués ne peuvent pas ignorer cet aspect énergétique.

Le coût du module est également élevé comparé à des solutions plus simples. Cela limite son usage aux projets industriels et à la recherche avancée. Les applications grand public ou les prototypes à très faible budget le trouveront probablement trop cher. La barrière financière reste réelle et mesurable.

D’un point de vue logiciel, Thor demande une compétence forte en IA embarquée. Les modèles doivent être optimisés pour tourner en temps réel sans surcharger le GPU. Les ingénieurs doivent maîtriser la quantification, la réduction de résolution et la gestion de la mémoire. Sinon, la puissance brute n’est pas pleinement exploitée.

La concurrence ne reste pas immobile devant ces choix techniques. D’autres plateformes IA embarquées proposent des compromis différents. Elles peuvent offrir une efficacité énergétique supérieure ou une intégration plus simple. Cela oblige les équipes à bien justifier leur choix de Thor par des benchmarks concrets.

- Partager l'article :