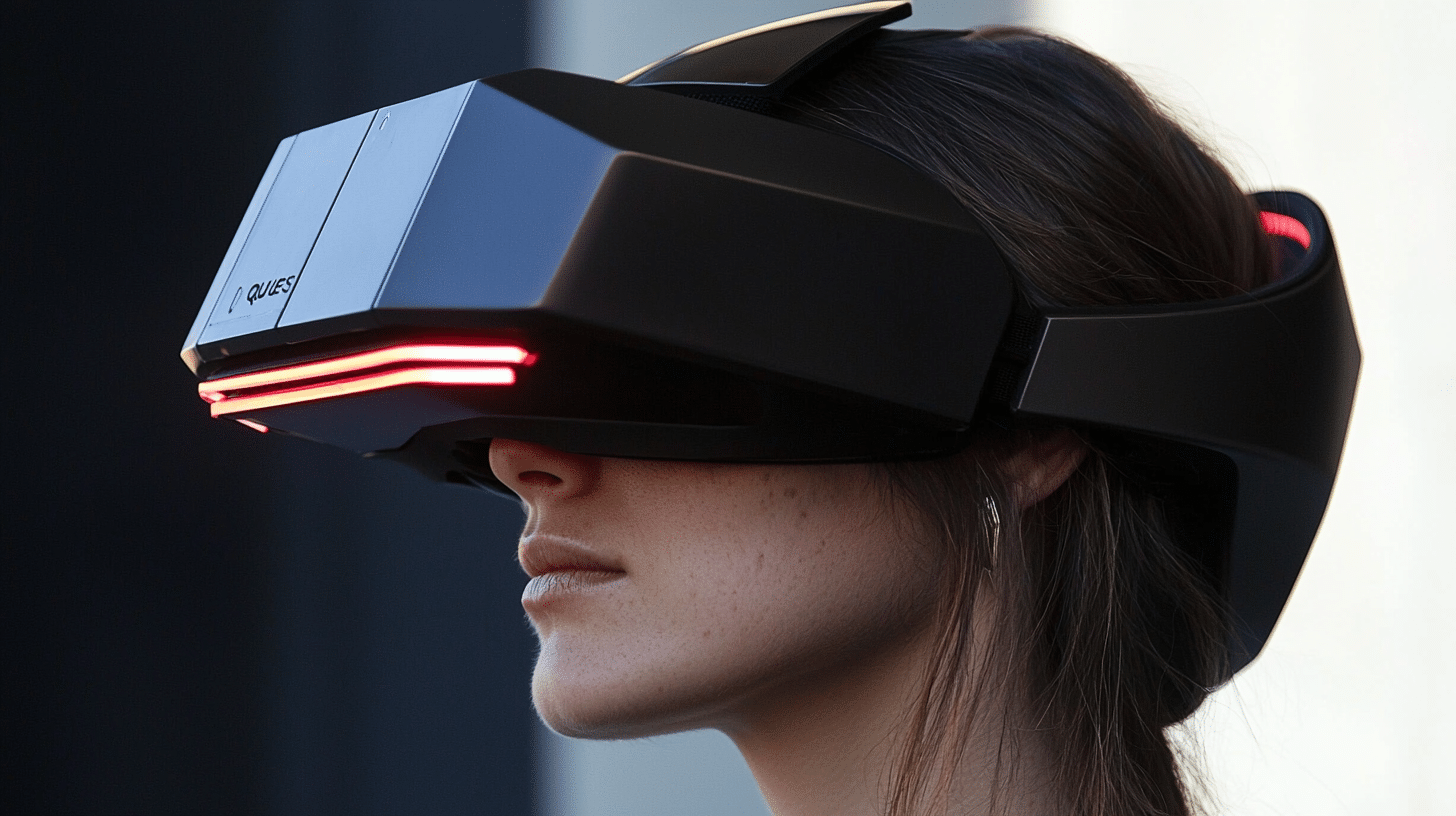

Andrew Bosworth nous a fait part de sa vision de ce que pourraient être les casques VR de l’entreprise en 2031. Découvrez les détails dans la suite de notre article !

Andrew Bosworth a clairement rejeté les spéculations futuristes extrêmes sur les casques VR Quest de 2031. Selon lui, les avancées des sept prochaines années ne transformeront pas autant notre quotidien que certains pourraient l’imaginer. Meta ne proposera donc pas des idées comme celles d’une interface neuronale directe ou d’un monde similaire à celui de Ready Player One.

Une réduction de poids

Bosworth a évoqué une réduction de poids du Quest de 100 à 200 grammes d’ici 2031. En 2026, cette transition a déjà commencé avec les recherches autour des designs à visière ouverte et à calcul déporté (les fameuses lunettes reliées à un boîtier externe).

En parallèle, il a souligné l’importance de l’équilibre du dispositif et de l’éloignement de la pile optique (les lentilles et écrans) par rapport au visage, ce qui est rendu possible par les nouvelles générations de lentilles Pancake et holographiques.

Bosworth reconnaît également les limites du système audio à oreilles ouvertes du Quest 3. Il envisage de fournir à l’avenir des options à oreilles fermées ou à isolation active. Cela répond aux besoins des utilisateurs qui cherchent une expérience audio plus immersive ou qui nécessitent une annulation de bruit dans les environnements de travail bruyants ou les transports.

Enfin, Boz pense que les casques n’ont pas besoin d’aller au-delà du taux de rafraîchissement de 120 Hz actuellement disponible. Pour atteindre un taux supérieur, Meta devrait sacrifier d’autres aspects du produit (comme l’autonomie ou la résolution). Ce qui suscite le scepticisme de Bosworth car l’œil humain est déjà trompé par du 120 Hz stable. L’effort sera donc mis sur la constance du framerate plutôt que sur la surenchère.

Le cloud gaming et la VR : quel avenir pour le Quest en 2031 ?

Le cloud gaming et la réalité virtuelle (VR) sont deux technologies dont la convergence transforme déjà l’expérience de jeu en 2026. L’un des casques VR les plus populaires, le Quest, pourrait connaître son évolution ultime d’ici 2031 grâce aux infrastructures cloud de nouvelle génération.

Aujourd’hui, les applications comme Xbox Cloud Gaming prouvent qu’il est possible de streamer de la 2D dans un casque. Toutefois, la véritable révolution pour 2031 est ce que l’industrie appelle le Split Rendering (rendu partagé).

Au lieu de tout calculer sur le casque ou tout sur un serveur, les tâches seront divisées. Le casque calculera les mouvements de tête pour éviter toute nausée (latence zéro), tandis que les textures 3D ultra-complexes et l’éclairage Ray-Tracing seront calculés à distance sur des serveurs surpuissants. Puis, ils seront envoyés instantanément à la visière.

On verra alors une évolution où les casques VR deviendront des appareils beaucoup plus légers (les fameux « lunettes » de 300 grammes) et plus accessibles d’ici 2031. La puissance de calcul lourde sera effectivement déportée. Par conséquent, les utilisateurs n’auront plus besoin d’un PC à 2000 € ou d’une puce brûlante sur le front pour vivre une expérience VR photoréaliste.

Par ailleurs, cette approche hybride permettra de diffuser des jeux aux graphismes dignes du cinéma, en temps réel. La réduction drastique de la latence, grâce à la généralisation de la 5G Advanced et l’émergence des réseaux Wi-Fi 7 et Wi-Fi 8, ouvrira la voie à une immersion totale. Le tout, sans les contraintes matérielles ou thermiques actuelles. L’avenir du Quest n’est plus seulement d’être une console autonome, mais le terminal ultime du métavers hébergé dans le Cloud.

Le défi des 60 PPD

Afficher 60 pixels par degré sur un écran miniature nécessite une puissance de calcul colossale, que les puces mobiles traditionnelles ne peuvent supporter sans fondre. Pour réaliser la vision de Bosworth d’ici 2031, Meta investit massivement dans le « rendu fovéal dynamique assisté par l’IA« .

En s’appuyant sur des modèles dérivés de Llama, le casque de 2031 n’aura besoin de calculer la très haute résolution (60 PPD) que sur la zone exacte où se pose la pupille du joueur. Tandis que la vision périphérique sera générée (upscalée) par une intelligence artificielle locale. Ce qui économiser près de 70 % des ressources graphiques.

- Partager l'article :